contraer cancer de piel

Identificar «patitos feos» para contraer cáncer de piel antes

El sistema basado en el aprendizaje profundo permite la identificación a nivel de dermatólogo de lesiones cutáneas sospechosas a partir de fotos de teléfonos inteligentes, lo que permite una mejor detección

16 de febrero de 2020 Por Lindsay Brownell

(BOSTON) — El melanoma es, con mucho, la forma más mortífera de cáncer de piel, matando a más de 7.000 personas solo en los Estados Unidos en 2019. La detección temprana de la enfermedad reduce drásticamente el riesgo de muerte y los costos del tratamiento, pero actualmente no es factible realizar un cribado generalizado del melanoma. Hay alrededor de 12.000 dermatólogos practicantes en los Estados Unidos, y cada uno de ellos necesitaría ver a 27.416 pacientes al año para detectar lesiones pigmentadas sospechosas (SPL) que puedan indicar cáncer.

Los dermatólogos evalúan muchas características de las lesiones cutáneas para determinar si se ven cancerosas. El sistema de aprendizaje profundo creado por los investigadores de Wyss y MIT también fue capacitado para evaluar lesiones en fotos utilizando estos criterios. Crédito: Luis Soenksen

En los últimos años se han desarrollado sistemas de diagnóstico asistido por ordenador (CAD) para tratar de resolver este problema mediante el análisis de imágenes de lesiones cutáneas y la identificación automática de las OPL, pero hasta ahora no han tenido un impacto significativo en el diagnóstico del melanoma. Estos algoritmos CAD están entrenados para evaluar cada lesión de la piel individualmente en busca de características sospechosas, pero los dermatólogos comparan múltiples lesiones de un paciente individual para determinar si son cancerosas – un método comúnmente llamado los criterios de «pato feo». Hasta la fecha, no se han diseñado sistemas CAD en dermatología para replicar este proceso de diagnóstico.

Luis R. Soenksen

Los dermatólogos evalúan muchas características de las lesiones cutáneas para determinar si se ve cancerosa. El sistema de aprendizaje profundo creado por los investigadores wyss y MIT también fue entrenado para evaluar lesiones en fotos utilizando estos criterios. Crédito: Luis Soenksen

Ahora, esa supervisión se ha corregido gracias a un nuevo sistema CAD para lesiones cutáneas basado en redes neuronales profundas (CDNN) enrevesadas desarrolladas por investigadores del Instituto Wyss de Ingeniería Biológicamente Inspirada en la Universidad de Harvard y el Instituto Tecnológico de Massachusetts (MIT). El nuevo sistema distinguió con éxito las SPLs de lesiones no sospechosas en fotos de la piel de los pacientes con ~90% de precisión, y por primera vez estableció una métrica de «patito feo» capaz de igualar el consenso de tres dermatólogos el 88% del tiempo.

Ahora, esa supervisión se ha corregido gracias a un nuevo sistema CAD para lesiones cutáneas basado en redes neuronales profundas (CDNN) enrevesadas desarrolladas por investigadores del Instituto Wyss de Ingeniería Biológicamente Inspirada en la Universidad de Harvard y el Instituto Tecnológico de Massachusetts (MIT). El nuevo sistema distinguió con éxito las SPLs de lesiones no sospechosas en fotos de la piel de los pacientes con ~90% de precisión, y por primera vez estableció una métrica de «patito feo» capaz de igualar el consenso de tres dermatólogos el 88% del tiempo. contraer cáncer de piel contraer cáncer de piel contraer cáncer de piel

«Esencialmente proporcionamos un proxy matemático bien definido para la intuición profunda en la que un dermatólogo se basa a la hora de determinar si una lesión cutánea es lo suficientemente sospechosa como para justificar un examen más detallado», dijo el primer autor del estudio, Luis Soenksen,Ph.D., un becario postdoctoral en el Instituto Wyss que también es un venture builder en el MIT. «Esta innovación permite analizar rápidamente las fotos de la piel de los pacientes para identificar lesiones que deben ser evaluadas por un dermatólogo, lo que permite una detección eficaz del melanoma a nivel poblacional». contraer cáncer de piel contraer cáncer de piel contraer cáncer de piel contraer cáncer de piel contraer cáncer de piel contraer cáncer de piel

La tecnología se describe en Science Translational Medicine, y el código fuente de la CDNN está abiertamente disponible en GitHub .

Poner a los patitos feos en el foco

El melanoma es personal para Soenksen, quien ha visto a varios amigos cercanos y familiares sufrir de la enfermedad. «Me sorprendió que la gente pueda morir de melanoma simplemente porque los médicos de atención primaria y los pacientes actualmente no tienen las herramientas para encontrar los «extraños» de manera eficiente. Decidí asumir ese problema aprovechando muchas de las técnicas que aprendí de mi trabajo en inteligencia artificial en el Wyss y el MIT», dijo.

Soenksen y sus colaboradores descubrieron que todos los sistemas CAD existentes creados para identificar las SPL sólo analizan las lesiones individualmente, omitiendo por completo los criterios de patito feo que los dermatólogos utilizan para comparar varios de los lunares de un paciente durante un examen. Así que decidieron construir los suyos.

Para garantizar que su sistema pudiera ser utilizado por personas sin formación especializada en dermatología, el equipo creó una base de datos de más de 33.000 imágenes de «campo ancho» de la piel de los pacientes que incluían fondos y otros objetos no cutáneos, de modo que la CDNN pueda utilizar fotos tomadas de cámaras de nivel de consumidor para el diagnóstico. Las imágenes contenían tanto SPLs como lesiones cutáneas no sospechosas que fueron etiquetadas y confirmadas por un consenso de tres dermatólogos certificados por la junta. Después de la capacitación en la base de datos y el posterior refinamiento y pruebas, el sistema fue capaz de distinguir entre lesiones sospechosas de no sospechosas con 90,3% de sensibilidad y 89,9% de especificidad, mejorando en los sistemas publicados anteriormente.

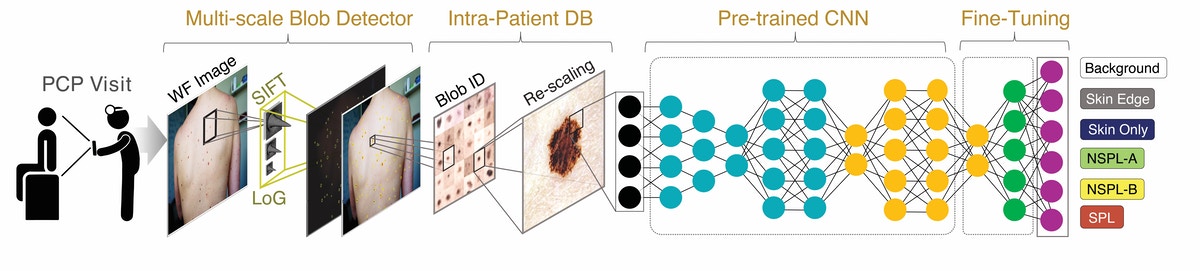

Aquí se muestra el flujo de datos del sistema. Primero, se toma una foto de la piel de un paciente y se introduce en el algoritmo. Luego, se detectan todas las regiones tipo blob y las imágenes de esas regiones se introducen en un clasificador profundo desarrollado utilizando una arquitectura de red neuronal convolucional (CNN) previamente entrenada y ajustada en un conjunto de datos de 33,980 imágenes de piel, bordes de piel y fondos. . Las lesiones pigmentadas detectadas se clasifican como sospechosas o no sospechosas utilizando probabilidades generadas por la capa densa de la red y también una «salida del patito feo» calculada utilizando las características profundas de la CNN. Crédito: Instituto Wyss de la Universidad de Harvard

El flujo de datos del sistema se muestra aquí. En primer lugar, se toma una foto de la piel de un paciente y se introduce en el algoritmo. A continuación, se detectan todas las regiones similares a blobs y las imágenes de esas regiones se introducen en un clasificador profundo desarrollado mediante una arquitectura de red neuronal convolucional (CNN) previamente restringida y se ajustan en un conjunto de datos de 33.980 imágenes de piel, bordes de piel y fondos. Las lesiones pigmentadas detectadas se clasifican como sospechosas o no caprichosas utilizando las probabilidades generadas por la capa densa de la red y también una «salida de pato feo» calculada utilizando las características profundas de la CNN. Crédito: El Instituto Wyss de la Universidad de Harvard Dermatólogos evalúa muchas características de las lesiones cutáneas para determinar si se ve cancerosa. El sistema de aprendizaje profundo creado por los investigadores de Wyss y el MIT también fue entrenado para evaluar lesiones en fotos utilizando estos criterios. Crédito: Luis Soenksen

Pero este sistema de referencia todavía estaba analizando las características de las lesiones individuales, en lugar de las características en múltiples lesiones como lo hacen los dermatólogos. Para añadir los feos criterios de patito a su modelo, el equipo utilizó las entidades extraídas en una etapa secundaria para crear un «mapa» 3D de todas las lesiones en una imagen determinada, y calculó cuán lejos estaban las características «típicas» de cada lesión. Cuanto más «extraña» era una lesión dada en comparación con las otras en una imagen, más lejos estaba del centro del espacio 3D. Esta distancia es la primera definición cuantificable de los feos criterios de patito, y sirve como puerta de entrada para aprovechar las redes de aprendizaje profundo para superar la difícil y lenta tarea de identificar y examinar las diferencias entre todas las lesiones pigmentadas en un solo paciente

Pero este sistema de referencia todavía estaba analizando las características de las lesiones individuales, en lugar de las características en múltiples lesiones como lo hacen los dermatólogos. Para añadir los feos criterios de patito a su modelo, el equipo utilizó las entidades extraídas en una etapa secundaria para crear un «mapa» 3D de todas las lesiones en una imagen determinada, y calculó cuán lejos estaban las características «típicas» de cada lesión. Cuanto más «extraña» era una lesión dada en comparación con las otras en una imagen, más lejos estaba del centro del espacio 3D. Esta distancia es la primera definición cuantificable de los feos criterios de patito, y sirve como puerta de entrada para aprovechar las redes de aprendizaje profundo para superar la difícil y lenta tarea de identificar y examinar las diferencias entre todas las lesiones pigmentadas en un solo paciente.

Aprendizaje profundo contra dermatólogos

Los investigadores utilizaron su red neuronal de aprendizaje profundo para asignar una «puntuación de patito feo» a cada lesión en función de su diferencia con otras lesiones en la piel del mismo paciente, identificando las que tienen más probabilidades de ser cancerosas. Crédito: Instituto Wyss de la Universidad de Harvard

Su DCNN todavía tenía que pasar una prueba final: realizar, así como vivir, respirar dermatólogos en la tarea de identificar spls a partir de imágenes de la piel de los pacientes. Tres dermatólogos examinaron 135 fotos de campo ancho de 68 pacientes, y asignaron a cada lesión una puntuación de «rareza» que indicaba lo preocupante que se veía. Las mismas imágenes fueron analizadas y puntuadas por el algoritmo. Cuando se compararon las evaluaciones, los investigadores encontraron que el algoritmo estaba de acuerdo con el consenso de los dermatólogos el 88% del tiempo, y con los dermatólogos individuales el 86% del tiempo.

Los investigadores utilizaron su red neuronal de aprendizaje profundo para asignar una «puntuación de patito feo» a cada lesión en función de cuánto difirió de otras lesiones en la piel del mismo paciente, identificando las más propensas a ser cancerosas. Crédito: Wyss Institute en la Universidad de Harvard

Los investigadores utilizaron su red neuronal de aprendizaje profundo para asignar una «puntuación de patito feo» a cada lesión en función de cuánto difirió de otras lesiones en la piel del mismo paciente, identificando las más propensas a ser cancerosas. Crédito: Wyss Institute en la Universidad de Harvard.

«Este alto nivel de consenso entre la inteligencia artificial y los médicos humanos es un avance importante en este campo, porque el acuerdo de los dermatólogos entre sí es típicamente muy alto, alrededor del 90%», dijo el coautor Jim Collins,Ph.D., miembro principal de la Facultad del Instituto Wyss y colíder de su Iniciativa Predictiva de Bioanalítica que también es el Profesor Termeer de Ingeniería Médica y Ciencia en el MIT.

James J. Collins

«Esencialmente, hemos sido capaces de lograr precisión a nivel de dermatólogo en el diagnóstico de posibles lesiones de cáncer de piel a partir de imágenes que pueden ser tomadas por cualquier persona con un teléfono inteligente, lo que abre un enorme potencial para encontrar y tratar el melanoma antes.»

Reconociendo que dicha tecnología debe ponerse a disposición de tantas personas como sea posible para obtener el máximo beneficio, el equipo ha hecho su algoritmo de código abierto en GitHub. Esperan asociarse con centros médicos para lanzar ensayos clínicos que demuestren aún más la eficacia de su sistema, y con la industria para convertirlo en un producto que podría ser utilizado por proveedores de atención primaria de todo el mundo. También reconocen que para ser universalmente útiles, su algoritmo debe ser capaz de funcionar igualmente bien en todo el espectro de tonos de piel humana, que planean incorporar en el desarrollo futuro.

Donald E. Ingber

El melanoma es un cáncer muy grave que a menudo se diagnostica demasiado tarde para salvar la vida de los pacientes, y la mayoría de las personas no visitan regularmente a un dermatólogo para exámenes de la piel. La identificación en etapas tempranas de lesiones pigmentadas sospechosas (SPLs), idealmente por los proveedores de atención primaria, podría conducir a un mejor pronóstico del melanoma. Investigadores del Instituto Wyss y el MIT han desarrollado un algoritmo de aprendizaje profundo que puede diferenciar las SPLs de las marcas de piel no cancerosas en imágenes de campo amplio de la piel de los pacientes, como las tomadas con una tableta o un teléfono celular. Este método podría permitir mejorar el triaje del paciente, reducir los costos médicos y un tratamiento más temprano del melanoma. Crédito: Wyss Institute en la Universidad de Harvard

«Permitir que nuestros científicos cerren sus pasiones y visiones es clave para el éxito del Instituto Wyss, y es maravilloso ver este avance que puede impactar a todos nosotros de una manera tan significativa que surge de una colaboración con nuestra recién formada Iniciativa Predictiva de BioAnalítica», dijo el Director Fundador de Wyss Don Ingber, M.D., Ph.D., quien también es profesor de biología vascular judah folkman en la Escuela de Medicina de Harvard y el Boston Children’s Hospital, y profesor de Bioingeniería en la Escuela de Ingeniería y Ciencias Aplicadas John A. Paulson de Harvard.

Jose Antonio Aviles-Izquierdo

Otros autores del trabajo son Regina Barzilay, Martha L. Gray, Timothy Kassis, Susan T. Conover, Berta Marti-Fuster, Judith S. Birkenfeld, Jason Tucker-Schwartz y Asif Naseem del MIT, Robert R. Stavert del Beth Israel Deaconess Medical Center, Caroline C. Kim del Tufts Medical Center, Maryanne M. Senna del Hospital General de Massachusetts, y José Avilés-Izquierdo del Hospital General Universitario Gregorio Marañón.

Esta investigación ha contado con el apoyo de la Clínica Abdul Latif Jameel para el Aprendizaje Automático en Salud, la Consejería de Educación, Juventud y Deportes de la Comunidad de Madrid a través del Consorcio Madrid-MIT M+Visión y el Programa de Personas del Séptimo Programa Marco de la Unión Europea, la beca México CONACyT 342369/40897, y la subvención de formación del DOE de la US DE-SC0008430.