Construyendo un robot preciso de alimentación asistida que pueda manejar cualquier comida

|

Comer una comida implica múltiples movimientos precisos para llevar la comida del plato a la boca.

El Grupo de Sistemas Autónomos Inteligentes e Interactivos de Stanford (ILIAD) desarrolla algoritmos para agentes de IA que interactúan de manera segura y confiable con las personas. Nuestra misión es desarrollar fundamentos teóricos para la interacción humano-robot y humano-IA. Nuestro grupo se centra en: 1) formalizar la interacción y desarrollar nuevos algoritmos de control y aprendizaje para sistemas interactivos inspirados en herramientas y técnicas de la teoría de juegos, la ciencia cognitiva, la optimización y el aprendizaje de representaciones, y 2) desarrollar algoritmos prácticos de robótica que permitan a los robots operar de manera segura. y coordinar, colaborar, competir o influir en los humanos sin problemas.

Agarramos un tenedor o una cuchara para ensartar o recoger una variedad de alimentos de diferentes formas y texturas sin romperlos o empujarlos fuera de nuestro plato. A continuación, llevamos la comida hacia nosotros sin dejarla caer, la introducimos en la boca en un ángulo cómodo, la mordemos y retiramos suavemente el utensilio con la fuerza suficiente para dejar la comida atrás. Y repetimos esa serie de acciones hasta que nuestros platos estén limpios, tres veces al día.

Para las personas con lesiones de la médula espinal u otros tipos de deficiencias motoras, realizar esta serie de movimientos sin ayuda puede ser casi imposible, lo que significa que deben depender de los cuidadores para alimentarlos. Esto reduce la autonomía de las personas y al mismo tiempo contribuye al agotamiento de los cuidadores, dice Jennifer Grannen, estudiante de posgrado en informática de la Universidad de Stanford.

Una alternativa: robots que puedan ayudar a las personas con discapacidad a alimentarse. Aunque ya existen dispositivos de alimentación robótica en el mercado, por lo general realizan movimientos preprogramados, deben configurarse con precisión para cada persona y cada comida, y llevan la comida a una posición frente a la boca de una persona en lugar de dentro de ella, lo que puede plantear problemas para las personas con movimientos muy limitados, dice Grannen.

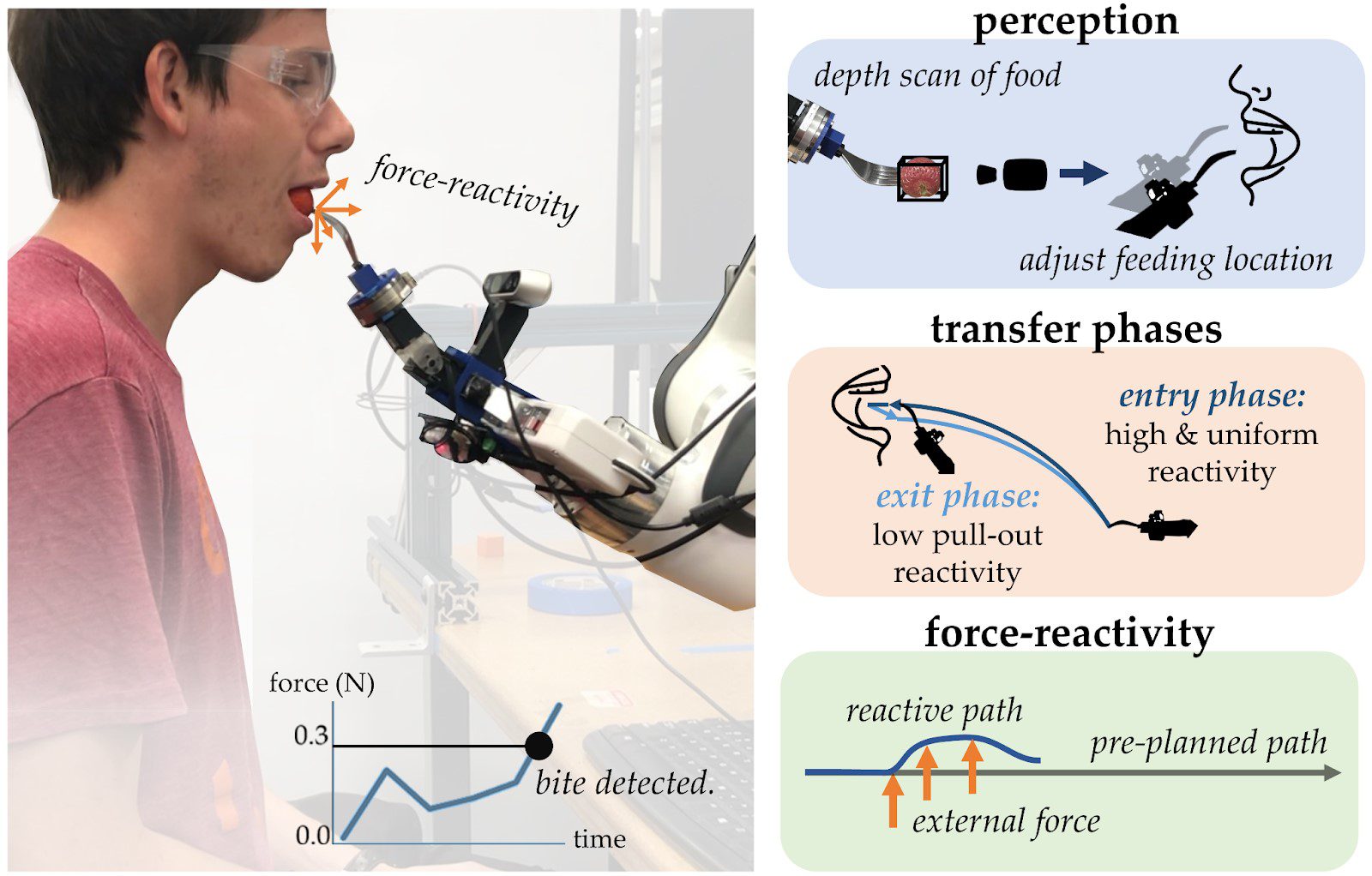

Los algoritmos combinan háptica y visión artificial para evaluar cómo insertar un tenedor en la boca de una persona de forma natural y cómoda.

Un equipo de investigación en el laboratorio ILIAD de Dorsa Sadigh , que incluye a Grannen y sus compañeros estudiantes de informática Priya Sundaresan, Suneel Belkhale, Yilin Wu y Lorenzo Shaikewitz, espera hacer que la alimentación asistida por robot sea más cómoda para todos los involucrados.

dorsa sadigh

El equipo ahora ha desarrollado varios algoritmos robóticos novedosos para lograr de manera autónoma y cómoda cada paso del proceso de alimentación para una variedad de tipos de alimentos. Un algoritmo combina la visión por computadora y la háptica para evaluar el ángulo y la velocidad a la que se inserta un tenedor en un alimento; otro usa un segundo brazo robótico para empujar la comida hacia una cuchara ; y un tercero entrega comida en la boca de una persona de una manera que se siente natural y cómoda.

“La esperanza es que al progresar en este dominio, las personas que dependen de la asistencia de un cuidador puedan eventualmente tener un estilo de vida más independiente”, dice Sundaresan.

Brochetas visuales y hápticas

Los alimentos vienen en una variedad de formas y tamaños. También varían en su fragilidad o robustez. Algunos (como el tofu) se rompen en pedazos cuando se ensartan con demasiada firmeza; otros que son más duros (como las zanahorias crudas) requieren un movimiento de ensartado firme.

Para recoger con éxito diversos artículos, el equipo equipó un brazo robótico con una cámara para proporcionar retroalimentación visual y un sensor de fuerza para proporcionar retroalimentación háptica. En la fase de entrenamiento, le ofrecieron al robot una variedad de alimentos que incluían alimentos que se veían iguales pero tenían diferentes niveles de fragilidad (p. ej., calabacín crudo versus cocido) y alimentos que se sentían suaves al tacto pero que eran inesperadamente firmes cuando se ensartaban en una brocheta (p. ej. , brócoli crudo).

Para maximizar las recolecciones exitosas con una rotura mínima, el sistema visual primero se dirige a un alimento y pone el tenedor en contacto con él en un ángulo apropiado utilizando un método derivado de investigaciones anteriores. Luego, el tenedor palpa suavemente la comida para determinar (usando el sensor de fuerza) si es frágil o robusta. Al mismo tiempo, la cámara proporciona información visual sobre cómo responde la comida a la sonda. Habiendo tomado su determinación de fragilidad/robustez utilizando señales tanto visuales como táctiles, el robot elige entre una de dos estrategias de ensartar, y actúa instantáneamente sobre ella: un movimiento vertical más rápido para artículos robustos y un movimiento en ángulo más suave para artículos frágiles.

El trabajo es el primero en combinar la visión y la háptica para ensartar una variedad de alimentos, y hacerlo en una interacción continua, dice Sundaresan. En los experimentos, el sistema superó los enfoques que no usan hápticos y también recuperó con éxito alimentos ambiguos como el brócoli crudo y la calabaza cruda y cocida. “El sistema depende de la visión si los hápticos son ambiguos, y de los hápticos si las imágenes son ambiguas”, dice Sundaresan. Sin embargo, algunos artículos evadieron el tenedor del robot. “Los artículos delgados como los guisantes chinos o las hojas de ensalada son muy difíciles”, dice ella.

Ella aprecia la forma en que el robot pincha su comida al igual que la gente. “Los humanos también reciben comentarios tanto visuales como táctiles y luego los usan para saber cómo insertar un tenedor”, dice. En ese sentido, este trabajo marca un paso hacia el diseño de robots de alimentación asistida que puedan comportarse de manera familiar y cómoda de usar.

Sacar con un empujón

Los enfoques existentes para la alimentación asistida a menudo requieren cambiar los utensilios para manejar diferentes tipos de alimentos. “Desea un sistema que pueda adquirir una gran cantidad de alimentos diferentes con una sola cuchara en lugar de cambiar la herramienta que está utilizando”, dice Grannen. Pero algunos alimentos, como los guisantes, se desprenden de una cuchara mientras que otros, como la gelatina o el tofu, se rompen.

Grannen y sus colegas se dieron cuenta de que las personas saben cómo resolver este problema: usan un segundo brazo que sostiene un tenedor u otra herramienta para empujar los guisantes hacia una cuchara. Entonces, el equipo instaló un robot bimanual con una cuchara en una mano y un empujador curvo en la otra. Y lo entrenaron para recoger una variedad de alimentos.

A medida que los dos utensilios se mueven uno hacia el otro a cada lado de un alimento, un sistema de visión por computadora clasifica el artículo como robusto o frágil y aprende a notar cuándo está a punto de romperse. En ese momento, los utensilios dejan de moverse uno hacia el otro y comienzan a levantarse, con el empujador siguiendo y girando hacia la cuchara para mantener la comida en su lugar.

Este es el primer trabajo que usa dos brazos robóticos para la adquisición de alimentos, dice Grannen. También está interesada en explorar otras tareas de alimentación bimanual, como cortar carne, lo que implica no solo planificar cómo cortar un trozo grande de comida, sino también cómo mantenerlo en su lugar mientras realiza un movimiento de aserrado. La sopa también es un desafío interesante, dice ella. «¿Cómo evitas que la cuchara se derrame y cómo inclinas el tazón para recuperar las últimas gotas?»

Transferencia de mordida

Una vez que la comida está en un tenedor o una cuchara, el brazo del robot debe llevarla a la boca de una persona de una manera que se sienta natural y cómoda, dice Belkhale. Hasta ahora, la mayoría de los robots simplemente llevaban la comida justo frente a la boca de una persona, lo que les obligaba a inclinarse hacia adelante o estirar el cuello para recuperar la comida de la cuchara o el tenedor. Pero ese es un movimiento difícil para las personas que están completamente inmóviles del cuello para abajo o para las personas con otros tipos de problemas de movilidad, dice.

Para resolver ese problema, el equipo de Stanford desarrolló un sistema robótico integrado que lleva la comida hasta la boca de una persona, se detiene justo después de que la comida entra en la boca, detecta cuándo la persona muerde y luego retira el utensilio.

El sistema incluye una nueva pieza de hardware que funciona como una articulación de muñeca, lo que hace que los movimientos del robot sean más parecidos a los humanos y más cómodos para las personas, dice Belkhale. Además, se basa en la visión artificial para detectar alimentos en el utensilio; para identificar rasgos faciales clave a medida que la comida se acerca a la boca; y para reconocer cuando la comida ha pasado el plano de la cara y ha entrado en la boca.

El sistema también utiliza un sensor de fuerza que ha sido diseñado para garantizar que todo el proceso sea cómodo para la persona que se alimenta. Inicialmente, a medida que la comida se acerca a la boca, el sensor de fuerza es muy reactivo para garantizar que el brazo del robot deje de moverse cuando el utensilio entre en contacto con los labios o la lengua de una persona. A continuación, el sensor registra a la persona que está mordiendo, lo que sirve como una señal para que el robot comience a retirar el utensilio, momento en el que el sensor de fuerza debe ser menos reactivo para que el brazo del robot ejerza la fuerza suficiente para dejar la comida dentro. la boca a medida que el utensilio se retira. “Este sistema integrado puede cambiar entre diferentes controladores y diferentes niveles de reactividad para cada paso”, dice Belkhale.

Alimentación asistida por IA

Hay mucho más trabajo por hacer antes de que se despliegue un robot de alimentación asistida ideal en la naturaleza, dicen los investigadores. Por ejemplo, los robots deben hacer un mejor trabajo al recoger lo que Sundaresan llama grupos de alimentos «adversarios», como artículos muy frágiles o muy delgados. También existe el desafío de cortar artículos grandes en pedazos del tamaño de un bocado o recoger alimentos con los dedos. Luego está la cuestión de cuál es la mejor manera para que las personas se comuniquen con el robot sobre qué comida quieren a continuación. Por ejemplo, ¿deberían los usuarios decir lo que necesitan a continuación, debería el robot aprender las preferencias e intenciones de los humanos con el tiempo, o debería haber alguna forma de autonomía compartida?

Una pregunta más importante: ¿Todos los pasos de adquisición de alimentos y transferencia de mordeduras eventualmente ocurrirán juntos en un solo sistema? “En este momento, todavía estamos en la etapa en la que trabajamos en cada uno de estos pasos de forma independiente”, dice Belkhale. “Pero eventualmente, el objetivo sería comenzar a unirlos”.

Leer más:

- Transferencia de mordida robótica en boca con detección visual y háptica

- Aprendizaje de políticas de recolección bimanual para la adquisición de alimentos

- Aprendizaje de estrategias de ensartado viso-háptico para la alimentación asistida por robot

La misión de Stanford HAI es promover la investigación, la educación, las políticas y la práctica de la IA para mejorar la condición humana. Más información